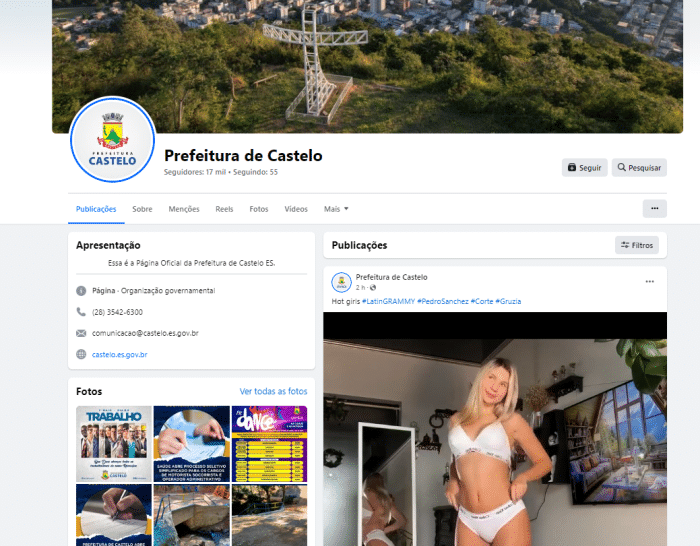

A Prefeitura de Castelo, localizada no sul do Espírito Santo, sofreu um ataque cibernético em seu perfil oficial do Facebook. A partir do dia 6 de maio, conteúdos de natureza sexual começaram a ser divulgados indevidamente pelos hackers.

Até a presente data, 25 de maio, as publicações inapropriadas continuam sendo feitas. Em resposta ao incidente, dois dias após o início das postagens indevidas, a administração municipal emitiu um comunicado por meio do Instagram. No aviso, informaram que o perfil havia sido comprometido e solicitaram desculpas pelo ocorrido.

Além disso, a Prefeitura de Castelo apelou à população para que ajudasse a combater a violação reportando a conta hackeada.

PROTEJA SUAS REDES SOCIAIS

Proteger sua conta do Facebook de ataques cibernéticos é crucial para manter sua segurança digital. Aqui estão algumas dicas práticas para ajudar a evitar que sua conta seja hackeada:

- Use uma senha forte e única: Evite senhas simples ou que já tenham sido usadas em outras contas. Combine letras maiúsculas e minúsculas, números e símbolos para criar uma senha complexa.

- Ative a autenticação de dois fatores (A2F): Essa é uma das medidas de segurança mais eficazes. Mesmo que alguém consiga sua senha, ainda precisará de um código de acesso enviado ao seu telefone para entrar na conta.

- Mantenha seu e-mail seguro: Garanta que o e-mail associado à sua conta do Facebook também esteja protegido, pois é um ponto de entrada para redefinir sua senha.

- Revise as configurações de segurança e login: Regularmente, verifique as configurações de segurança do Facebook para qualquer atividade suspeita e assegure-se de que apenas dispositivos e sessões reconhecidos estão conectados à sua conta.

- Evite clicar em links suspeitos: Hackers frequentemente usam links que parecem legítimos para roubar suas informações. Verifique sempre a URL antes de clicar e não insira seus dados em sites que não pareçam confiáveis.

- Atualize seu software regularmente: Mantenha seu sistema operacional e aplicativos, incluindo o aplicativo do Facebook, atualizados para proteger-se contra vulnerabilidades de segurança.

- Use um gerenciador de senhas: Para ajudar a gerenciar e proteger suas senhas, considere o uso de um gerenciador de senhas confiável.

- Eduque-se sobre phishing: Esteja ciente de técnicas de phishing que podem tentar enganá-lo para que você revele informações pessoais ou de login. Desconfie de mensagens ou e-mails que solicitam informações confidenciais.

- Limite as informações compartilhadas online: Quanto menos informações pessoais você compartilhar, menor será o risco de ser alvo de hackers.

Implementando essas medidas, você aumentará significativamente a segurança da sua conta no Facebook e reduzirá o risco de invasões indesejadas.